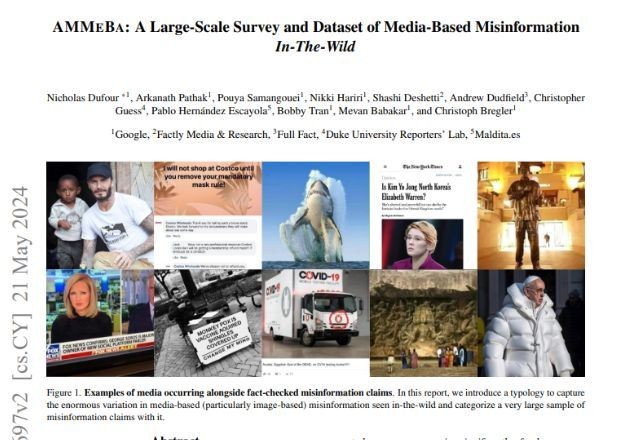

Pesquisa liderada pelo Google comprova que IA turbina fake news

Estudo mostra como a tecnologia de inteligência artificial tem ganhado popularidade para uso na manipulação das informações

Cido Coelho

Um grupo formado por pesquisadores do Google, da Duke University e de várias organizações de mídia responsáveis por verificação de fatos e na luta contra a desinformação publicaram um estudo que comprova que a inteligência artificial (IA) já é a principal responsável pela criação e disseminação de fake news.

O estudo publicado relata que as imagens geradas pela IA ganham engajamento rapidamente e se destacam, tornando-se tão populares como os conteúdos publicados por meios de comunicação tradicionais.

"A ascensão de ferramentas generativas baseadas em IA, que fornecem métodos amplamente acessíveis, sintetizando áudio, imagens, texto, vídeos realistas e sons semelhantes aos humanos, amplia essas preocupações", alerta a pesquisa.

Foram avaliados cerca de 136 mil fatos verificados que alegam desinformação desde 1995, sendo que 80% delas envolvem alguma mídia, como imagens, com uso de texto, e vídeos.

Os casos da imagem da Taylor Swift nua, que viralizou no antigo Twitter (atual X), o Papa Francisco com um casaco branco e imagens modificadas de empresas e empresários ajudando as vítimas do temporal no Rio Grande do Sul mostram que a ferramenta já é usada para confundir, enganar e alterar a narrativa original.

“As imagens geradas por IA representavam uma proporção mínima das manipulações de conteúdo em geral até o início do ano passado”, aponta a pesquisa.

Esse aumento de verificação de imagens geradas por IA coincidiu com o crescente entusiasmo gerado pela nova tecnologia, onde muitos sites e produtores de conteúdo se concentraram em usar a novidade para produzir material informativo ou lúdico.

Ao mesmo tempo, a pesquisa aponta que o uso da IA em si na verificação de fatos deu uma reduzida, enquanto a manipulação 'artesanal' produzida por texto e imagens mostra um aumento na sua produção.

Os boatos em vídeo aumentaram, representando quase 60% de todas as alegações verificadas que incluem mídia.

Entre os tipos de manipulação mais comuns detectadas na pesquisa estão as de conteúdo, quando há alteração na foto por "Photoshop" ou por vídeo como as Deepfakes, ou são feitas as manipulações de contexto, com inserção de informações falsas sobre uma imagem para alterar a narrativa.

Além das imagens baseadas em texto, que não exigem uma qualidade específica do conteúdo visual, mas as afirmações de desinformação são inseridas para mudar um contexto.

Mesmo assim, os pesquisadores reforçam as preocupações de que a IA segue em uso para a produção de conteúdo enganoso com uma qualidade cada vez superior e realista, ficando a critério do criador do conteúdo a finalidade de uso deste material para o bem ou para o mal.

"A explosão de métodos generativos baseados em IA inflamou estas preocupações, uma vez que podem sintetizar conteúdo áudio e visual altamente realista, bem como texto natural e fluente numa escala anteriormente impossível, sem uma enorme quantidade de trabalho manual. Esses métodos estão melhorando rapidamente tanto na qualidade do conteúdo sintetizado quanto na sua adesão às intenções do usuário", explica o estudo.