Califórnia aprova lei pioneira que prevê protocolos de segurança para crianças no uso de IA

Novo pacote legislativo cria regras para plataformas digitais, responsabiliza empresas de IA e endurece punições para crimes com deepfakes

Governador da Califórnia, Gavin Newsom, aprovou lei nesta segunda-feira (13) - REUTERS/Kylie Cooper

O governador da Califórnia, Gavin Newsom, aprovou nesta segunda-feira (13) uma nova lei para proteger as crianças na internet e cria regras inéditas para o uso seguro da inteligência artificial (IA).

A legislação, conhecida como SB 53, exige verificação de idade, impõe protocolos de segurança para chatbots e endurece penalidades contra a distribuição de deepfakes ilegais.

Segundo a lei, as plataformas e produtos digitais deverão adotar verificações obrigatórias de idade, alertas sobre riscos de uso prolongado e protocolos para lidar com situações de suicídio e automutilação.

A legislação também impõe responsabilização direta para empresas e desenvolvedores de IA que causarem danos por meio de seus sistemas.

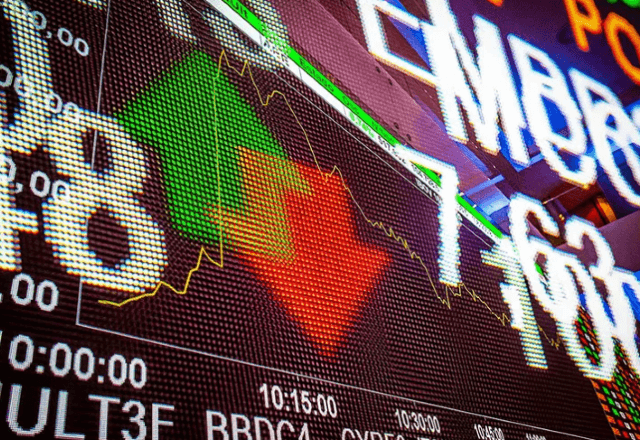

A Califórnia concentra a sede de gigantes da tecnologia e IA, como OpenAI, Google, Meta Platforms, Nvidia e Anthropic. Ao criar regras próprias, o estado busca se posicionar como referência global na regulação de um setor que deve movimentar trilhões nos próximos anos.

“A Califórnia provou que podemos estabelecer regulamentações para proteger nossas comunidades e, ao mesmo tempo, garantir que o crescente setor de IA continue a prosperar”, disse Newsom em um comunicado à imprensa sobre a lei.

Quais são as principais medidas aprovadas?

- Chatbots de IA deverão alertar usuários de que interagem com sistemas artificiais, ter protocolos para identificar risco de suicídio ou automutilação e impedir menores de ver conteúdo sexual explícito.

- Verificação de idade obrigatória para acesso a aplicativos e sistemas operacionais.

- Alertas sobre riscos de redes sociais direcionados a usuários jovens.

- Punições mais severas para deepfakes, permitindo que vítimas, inclusive menores, processem responsáveis por danos civis de até US$ 250 mil.

- Política contra cyberbullying, a ser adotada por escolas até junho de 2026.

- Responsabilidade legal para desenvolvedores de IA, impedindo que aleguem autonomia da tecnologia para escapar de sanções.

Por que a lei é considerada pioneira?

A medida preenche lacunas deixadas pelo Congresso dos EUA, que ainda não aprovou uma regulação federal ampla sobre IA. O gabinete de Newsom afirmou que a lei pode servir de modelo nacional para outros estados e para o governo federal.