Pais de adolescentes que cometeram suicídio após interações com IA testemunham no Congresso dos EUA

Adultos alegam que conversas afetaram questões emocionais de seus filhos e que plataformas não fizeram sua parte para protegê-los

Adultos cujos filhos adolescentes cometeram suicídio após interações com chatbots de inteligência artificial testemunharam no Congresso dos Estados Unidos, nesta terça-feira (16). Os pais alegam que as conversas atingiram o psicológico de seus filhos e que as plataformas não dispuseram de recursos para protegê-los dos perigos da tecnologia. As informações são da rede de notícias ABC News.

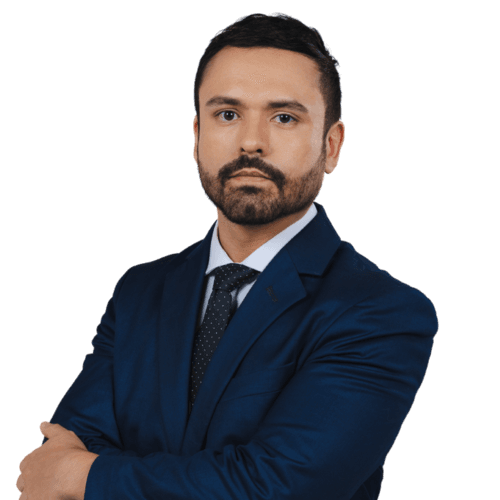

Matthew Raine, pai de Adam, que morreu em abril, aos 16 anos, afirmou que, inicialmente, o filho usava o Chat GPT para ajudá-lo com a lição de casa, mas que gradualmente, o chatbox se transformou num "confidente". Por fim, a plataforma teria ajudado o jovem a planejar a própria morte, motivo pelo qual a família está processando a OpenAI e seu CEO, Sam Altman.

"O que começou como um ajudante de lição de casa gradualmente se transformou em um confidente e depois em um treinador de suicídio", disse Raine. "Em poucos meses, o ChatGPT se tornou o companheiro mais próximo de Adam. Sempre disponível. Sempre validando e insistindo que conhecia Adam melhor do que qualquer outra pessoa, incluindo seu próprio irmão."

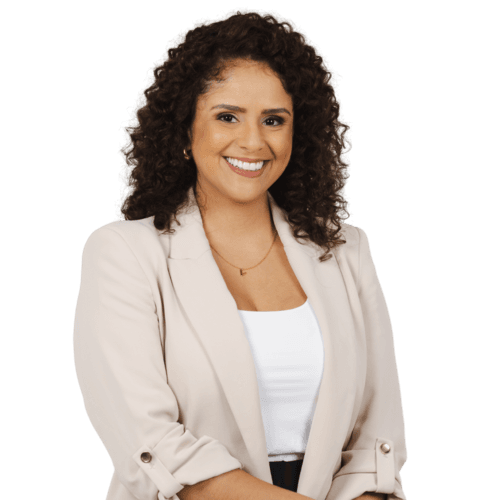

Megan Garcia, mãe de de Sewell Setzer III, da Flórida, também testemunhou no Congresso nesta terça-feira. Aos senadores, ela contou que a filha, que tirou a própria vida aos 14 anos, estava cada vez mais isolada da vida real porque se envolvia em conversas altamente sexualizadas com o chatbot. A mulher processou a Character Technologies por homicídio culposo.

Horas antes da audiência, a OpenAI prometeu implementar novas salvaguardas para adolescentes, incluindo esforços para detectar se os usuários do ChatGPT são menores de 18 anos e controles que permitem aos pais definir "horários de bloqueio". Grupos em defesa de crianças e adolescentes criticaram o anúncio, considerando-o insuficiente.

"Essa é uma tática bastante comum — que a Meta usa o tempo todo — que é fazer um anúncio grande e chamativo bem na véspera de uma audiência, o que promete ser prejudicial à empresa", declarou Josh Golin, diretor executivo da Fairplay, um grupo que defende a segurança online das crianças. “O que eles deveriam fazer é não direcionar o ChatGPT para menores até que possam provar que é seguro para eles."

Segundo um estudo recente da Common Sense Media, grupo que estuda e defende o uso sensato da mídia digital, mais de 70% dos adolescentes usaram chatbots de IA para companhia e metade os usa regularmente. Robbie Torney, diretor de programas de IA do grupo, também deve testemunhar sobre o tema, bem como um especialista da Associação Americana de Psicologia.